꺼내먹는지식 준

mAP란? FLOPs 란? 본문

TP 등 어떻게 기억할까?

TP: 뒤에 오는 것이 모델의 예측, 즉 P 모델이 postiive라고 예측했는데, T 맞았다.

FN: 모델이 Negative라고 예측했는데, F 틀렸다. (positive이다.) 즉 검출 되어야 할 것이 검출되지 않았다.

와 같이 기억하자.

Positive라고 예측한 케이스 중에서 옳게 예측한 케이스

모든 Positive 케이스 중에서 옳게 예측한 케이스

Recall: 옳게 예측한 케이스 / 모든 positive 케이스

... 예측 완료

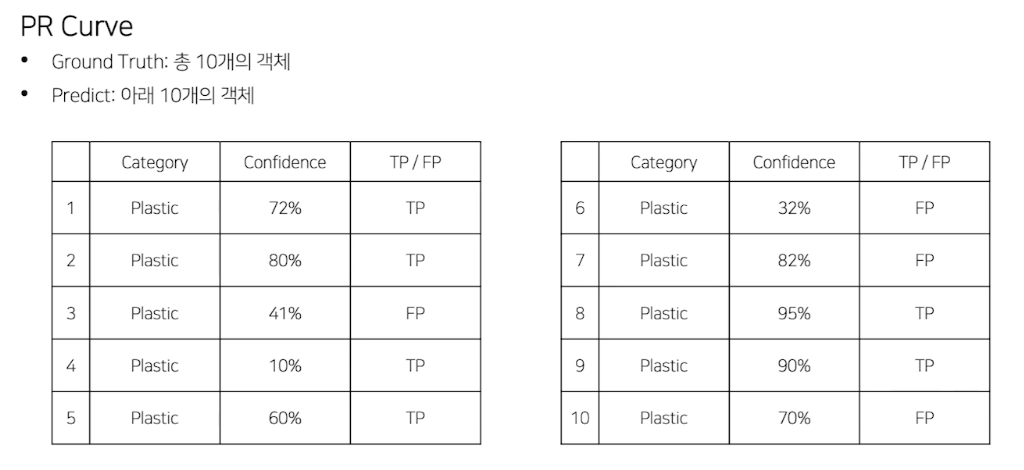

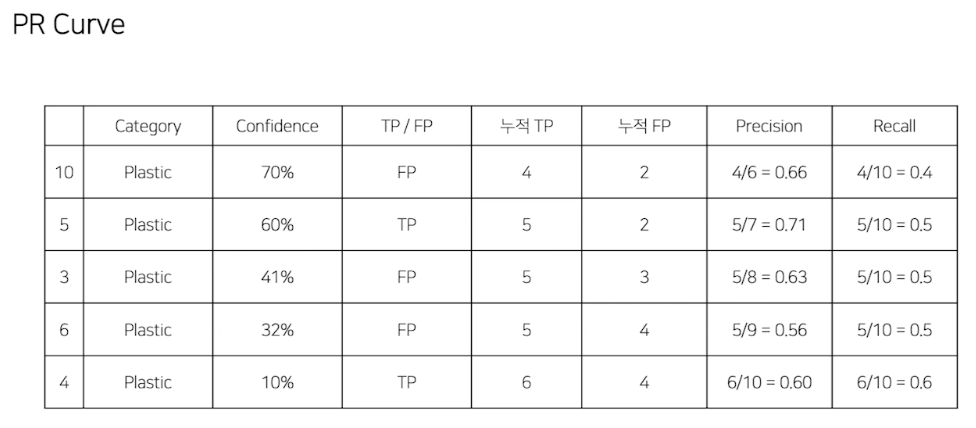

모든 예측에 대해 confidence score로 정렬 후, 누적 TP, FP를 계산해서 precision 과 recall 계산,

Y: precision X: Recall로 graph 그리기

AP는 거의 유사, 다만 떨어지는 부분 위로 mapping

모든 클래스를 계산해서 평균을 내준 것.

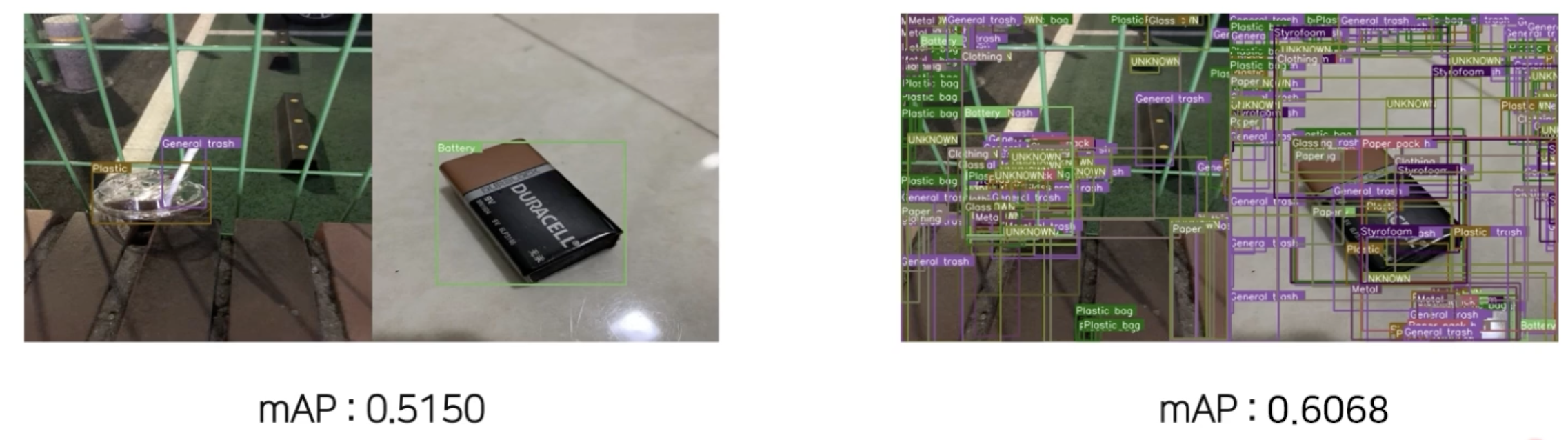

mAP의 위험성

threshold 를 높혀서 박스를 딱 정확한 곳에만 치면 물체를 놓쳐 recall이 1이 될 가능성이 낮다.

무지성으로 박스를 치면 당연히 recall이 1이 될 가능성이 높다.

그러다보니 그래프 내에서 포함 범위가 넓어져서 mAP 가 더 큰 값이 될 가능성이 높다.

threshold 값에 따른 pr curve의 형태가 다른 것을 확인할 수 있다.

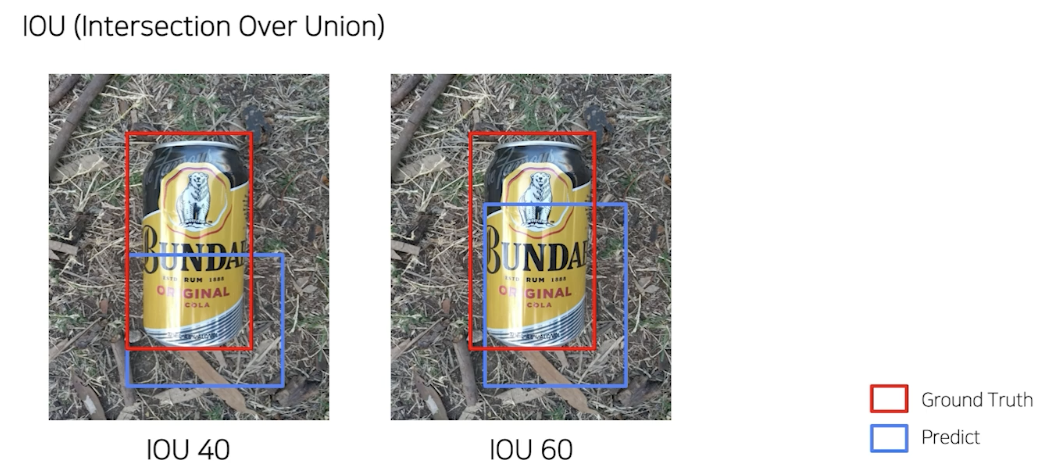

IoU 기준에 따라서 True False가 바뀐다.

mAP도 IoU에 따라 성능이 바뀌게 된다.

$\rightarrow$ mAP50, mAP60, mAP70 ... mAP95

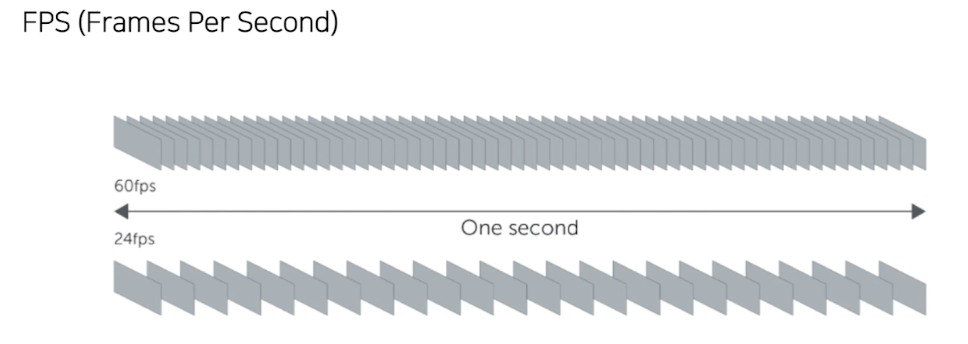

속도 평가

초당 처리 frame 숫자

작으면 작을 수록 빠른 모델

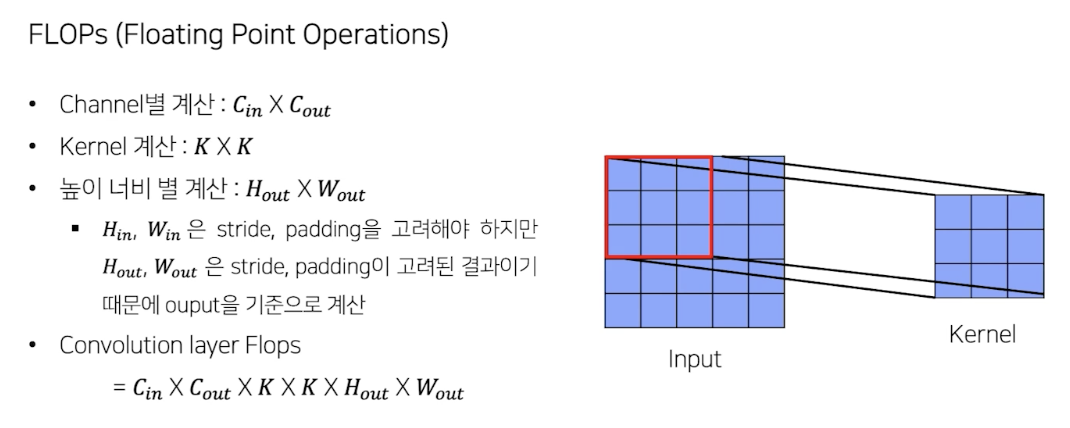

FLOPs 에서 주로 덧셈은 생략

'AI > CV' 카테고리의 다른 글

| MMdetection (0) | 2022.03.22 |

|---|---|

| COCO data 처리 (0) | 2022.03.22 |

| YOLO v3 (0) | 2022.03.19 |

| 3D Understanding (0) | 2022.03.17 |

| Multi modal learning (0) | 2022.03.17 |